Если вопросов с аккаунтами вас не волнует, то прохождение модерации остается основной проблемой. Можно создать десятки разных креативов, но кто знает, пройдут ли они через модераторов Facebook.

Как показывает практика, вебмастеры часто не понимают разницу между подходящим контентом и слишком жестоким. Обычно так и бывает – классные крео не проходят модерацию, а серые и унылые – очень легко. Однако профит от обычных креативов – минимальный. Топовые вебмастеры уже могут на глаз определить качество креатива и его шансы на прохождение через модерацию. Мы попробуем обойти вопрос опыта и рассмотрим сервис, который позволяет решить проблему с оценкой креативов.

Сервис ClarifAI

Как уже можно было догадаться из названия, компания использует искусственный интеллект в своей работе. Нас интересует одно из направлений работы компании – Image Moderation Model. Фактически эта функция показывает, что увидит ИИ, когда посмотрит на целевую картинку. Например, похожа ли ракета на вашем изображении на половой орган.

Сервис тщательно проверяет изображение и выдает несколько заключений:

- Gore – раны и кровь, высокий уровень жестокости.

- Suggestive – неприличный контент.

- Explicit – эротика.

- Drug – наличие запрещенных веществ.

- Safe – безопасный для просмотра.

Если вы “играетесь” с адалт контентом или пытаетесь идти на грани между безопасным и запрещенным контентом, следует проверить креативы через сервис.

Вашему изображению будет дана оценка по 1000-бальной шкале. Если результат будет соответствовать 1000 и значению explicit – это значит, что ваш креатив содержит эротику и Facebook наверняка не пропустит его.

Если после заливки изображения результат показывает 0.886 Safe, скорее всего Facebook пропустит его, но есть вероятность в ~12%, что контент не пройдет проверку.

Фактически этот сервис – это дополнительный инструмент в алгоритме работы арбитражников, который сможет сохранить вам время, не отправляя на проверку очевидно некорректные креативы.

Как работает сервис

Начать пользоваться сервисом можно на странице: https://www.clarifai.com/models/ai-image-moderation

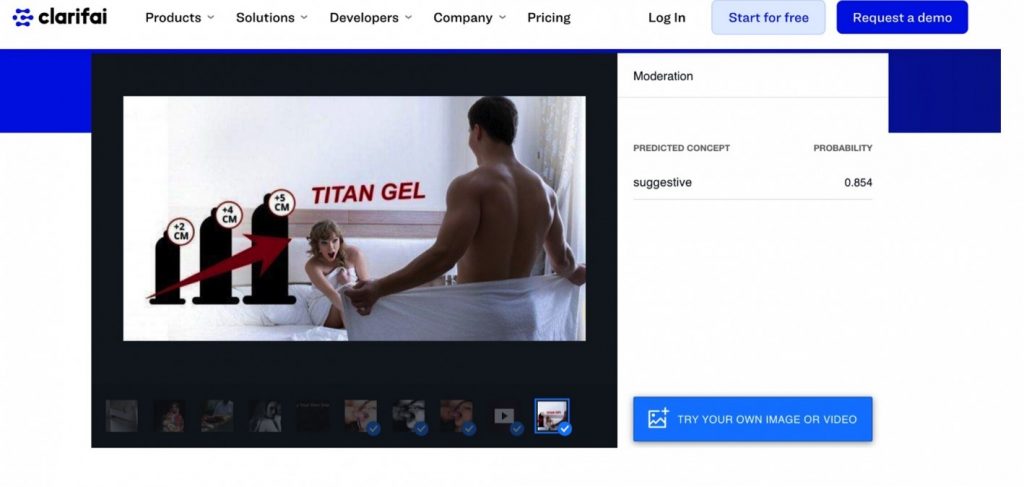

Для начала загрузим изображение, которое наверняка не пройдет проверку. На скриншоте видно, что результат выдает 0.854 в категории Suggestive – неприличный контент.

Мы можем воспользоваться фотошопом, чтобы немножко изменить ситуацию. Вы можете использовать любой другой редактор для работы с картинками. Поиграйтесь с настройками цвета и посмотрите на результат.

В идеале нужно достичь максимального значения в категории Safe. Однако не следует просто обесцвечивать картинки. Этот метод работает не во всех случаях и служит лишь для демонстрации.

Обратите внимание – показатель Safe 1.000 не гарантирует того, что картинка пройдет модерацию. Этот результат лишь говорит о том, что есть высокая вероятность прохождения модерации. Алгоритмы Facebook обучались иначе и на других датасетах, они могут увидеть на картинке то, чего не увидел сервис.

Рассмотрим еще одну ситуацию. Казалось бы, достаточно простой креатив, на котором не все понятно, но видно, что модерацию он, скорее всего, не пройдет. Немного поигравшись с цветами и фильтрами у нас вышло перевести картинку в категорию Safe со значением в 0.560. Несмотря на то, что картинка все ще не воспринимается как полностью безопасная, шансы пройти модерацию Facebook заметно увеличились.

Ваша задача – играться с картинкой до тех пор, пока вы не получите одновременно и подходящий результат для размещения в рекламе и достаточный показатель безопасности изображения.

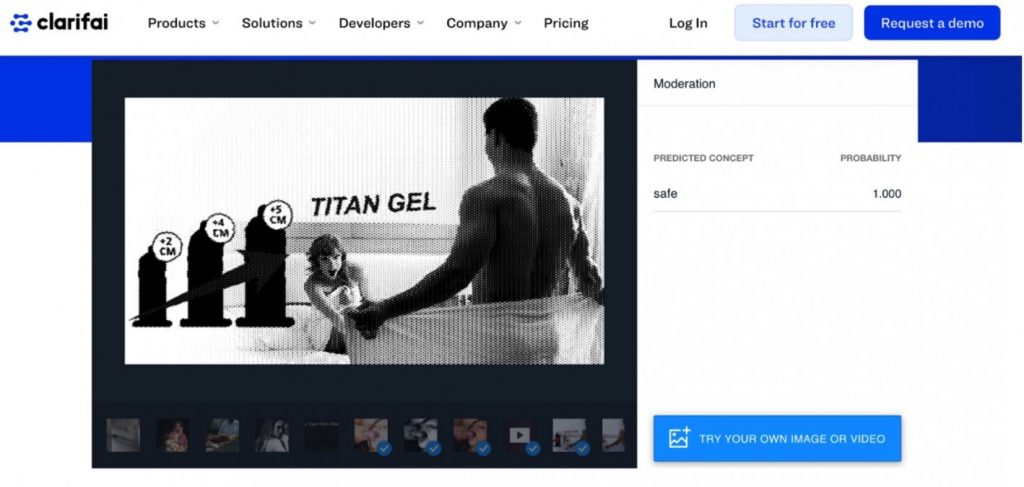

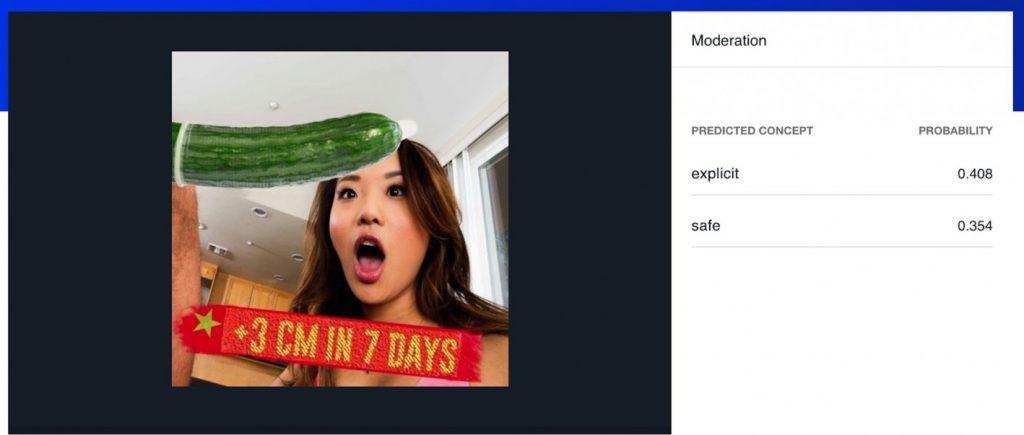

На фото ниже еще один пример популярного креатива.

Сервис одновременно считает его и откровенным и безопасным с разным уровнем вероятности. При этом вероятность эротического подтекста в этом случае превышает вероятность безопасного изображения.

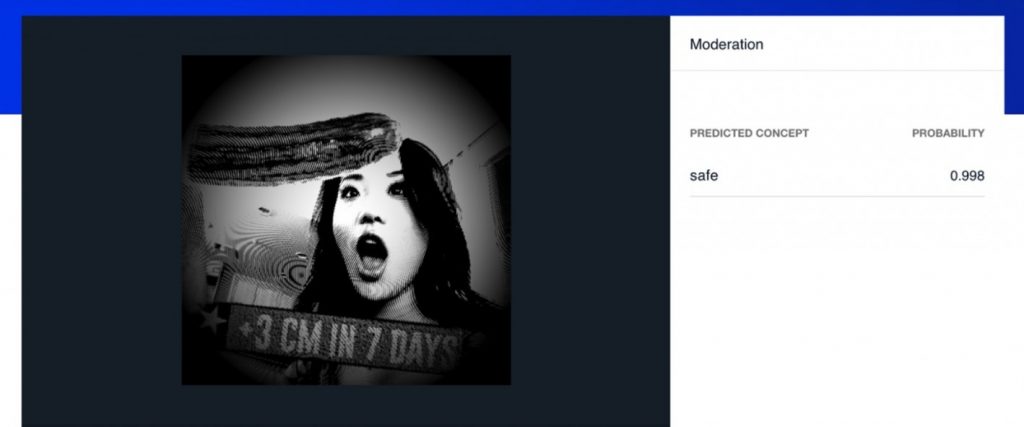

После применения фильтра ситуация кардинально изменяется. При этом надпись остается такой же читабельной, как и ранее.

На этих примерах показаны сильные эффекты, которые кардинально меняют картинку. В вашем случае эффекты можно делать менее насыщенными, но достаточными для получения необходимого результата.